“信頼”も生成できるのか?AI・ディープフェイク時代に問われる広報の真価

生成AIの急速な進化により、誰もが言葉や画像・映像を自由自在に作り出せる時代──。

情報の発信・拡散が一般化される一方、「本物」と「つくられたもの」の境界が曖昧になりつつある中、広報は今、「情報を届ける」役割から、「信頼を生成する」存在へと進化を迫られています。

AIを恐れるのではなく、共創するパートナーとして活用し、「信頼を生成する」には、どのように世の中の情報やAIと向き合うべきなのでしょうか。

その実践的なヒントを、日本ファクトチェックセンターの編集長を務める古田大輔氏に伺いました。

今回は、AI・ディープフェイクによって企業が直面するリスクと、日本の対策状況を解説した後、信頼を生み出すための危機対応方法、企業の取り組み事例と、そして生成AIと“共創”するための効果的な活用方法についてご紹介していきます。

古田大輔(ふるただいすけ)氏 / 日本ファクトチェックセンター編集長

福岡出身、早稲田大学政治経済学部卒業。朝日新聞記者、BuzzFeed Japan創刊編集長を経て、2019年に独立。デジタル報道の推進やニュースメディアの組織を超えたコラボレーション、ファクトチェックやリテラシー教育の普及をテーマとして活動し、2020~2022年には、Google News Lab Teaching Fellowとして、2万人超のジャーナリストや学生、研究者らにデジタル報道トレーニングを実施。

2022年9月、日本ファクトチェックセンター(JFC)の設立とともに編集長に就任。その他、デジタル・ジャーナリスト育成機構(D-JEDI)事務局長、ファクトチェック・イニシアティブ理事、早稲田大や近畿大の非常勤講師などを務める。

著書に『子どもを育てられるなんて思わなかった LGBTQと「伝統的な家族」のこれから』(編著、山川出版社)など。

▶電通PRコンサルティング「デジタルPR」サービス紹介資料をダウンロード

目次[非表示]

AI・ディープフェイク時代に加速する企業リスク

──近年、国内外で「生成AIに関わるフェイクニュース」による企業リスクが顕在化し始めています。

企業が直面するリスクと、その背景にある構造についてどのように考えておられますか。

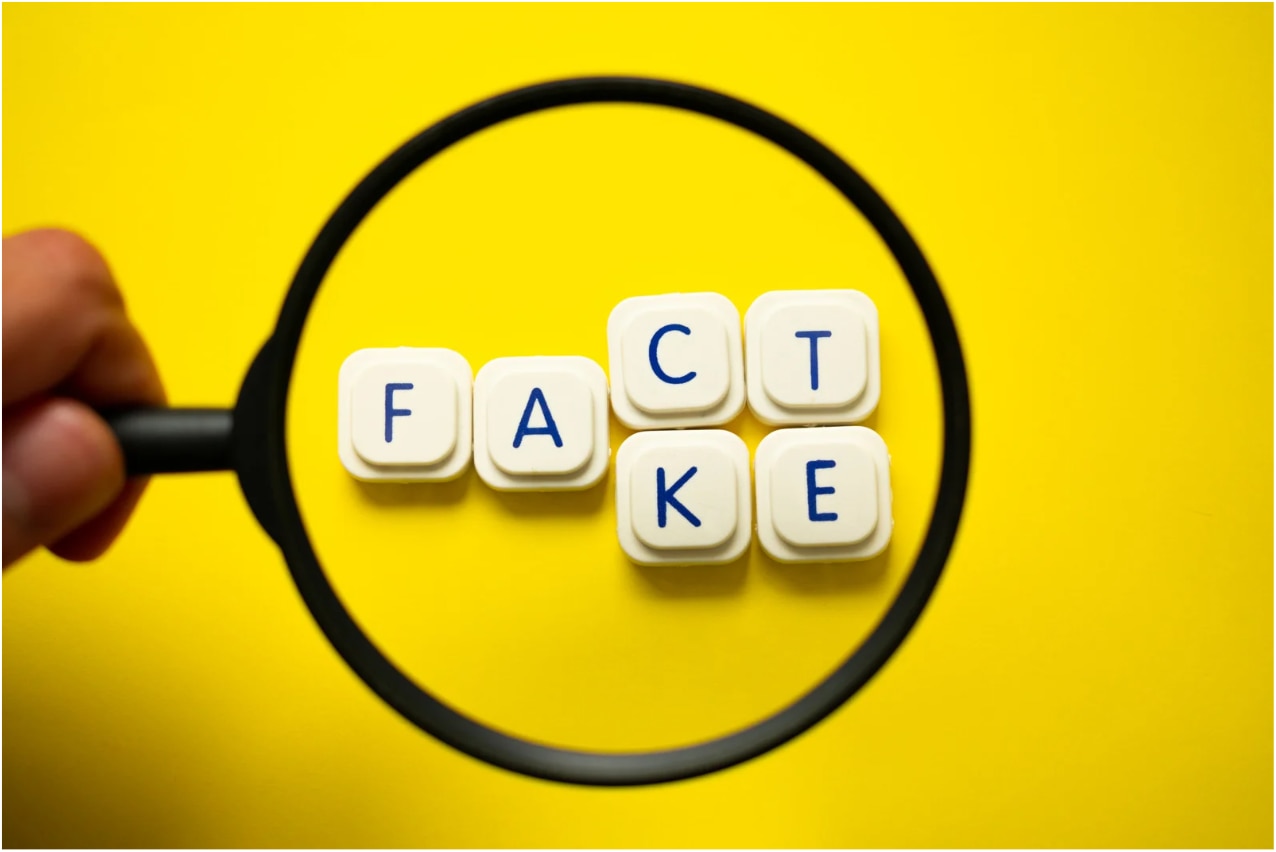

生成AIやディープフェイク技術が急速に普及する中、企業が直面する情報リスクはかつてない規模へと拡大しています。企業が抱えるリスクは大きく2つに分けられます。1つは、誤情報・偽情報によってブランド毀損や業務停滞、人材への影響などを招く「被害者になるリスク」。もう1つは、企業自身が発信源となってしまう「加害者になるリスク」です。

そもそもフェイクニュースは、インターネットやAI登場以前から存在してきた社会課題です。

しかし現在は、SNSによる圧倒的な拡散力に加え、生成AIによってディープフェイクが一般化され、フェイクニュースを「誰でも・簡単に・大量に」作成できる時代になったことで、誤情報・偽情報の発信・拡散のハードルが劇的に下がっています。

その結果、悪意がある発信者に限らず、一般の生活者や企業が意図せずにこれらの拡散に加担してしまうリスクが日常的に存在するようになりました。企業はこれまで以上に、被害者にも加害者にもなり得る環境に置かれており、生成AI時代におけるフェイクニュース対策は、企業運営の根幹に組み込むべき必須要件となっています。

ディープフェイク拡大の中で問われる日本の偽情報対策

──国内外でディープフェイクや偽情報が増加する中、企業の有効な対策や、日本におけるフェイクニュース対策についてどのようにお考えでしょうか。

国内外でディープフェイクや偽情報が増加する中、日本企業における偽情報対策は依然として十分とは言えません。対策が未成熟であること自体が偽情報の生成・拡散を許す一因となっています。

世界に目を向けると、欧米、特に欧州では法規制やメディアリテラシー教育が比較的進んでいるものの、それでも十分な対策には至っていません。各国が対応に苦戦している状況の中で、日本はさらに議論や制度整備が遅れているという課題があります。その背景には、日本ではこれまで海外ほど深刻な偽情報問題が多発してこなかったことから、社会全体として危機感を抱きにくく、対策が後手に回ってきたことが挙げられます。

一方で、生成AIの一般化やSNSによる拡散スピードの高まりを踏まえると、日本でも偽情報リスクは今後確実に増加すると考えられます。

こうした状況下では、偽情報を抑制するための強力なルール整備や、「AI生成物である」ことを明確に示す仕組みづくりが不可欠です。現状のウォーターマークは生活者が気づきにくいという課題もあり、制度面の改善と並行して、生活者のメディアリテラシー向上に社会全体で取り組むことが求められています。

誤情報・偽情報社会における信頼維持と危機対応

──誤情報や偽情報が拡散してしまった際、広報としてどこに気をつけるべきでしょうか。ファクト訂正以外に、信頼回復につながる姿勢やコミュニケーションがあれば教えてください。

誤情報・偽情報への向き合い方は難しいのですが、対応は「無視・反論・法的措置」の3つに分かれます。ただ、世の中には膨大な情報が流れているので、全てに反応することは不可能ですし、投稿に反論すると逆に注目を集めてしまうこともあります。だからまず大事なのは、きちんとしたリスク評価です。そのためには、対応する体制づくりが不可欠です。

誰が、どんな基準で、どの程度の広がりなら対応するのか──定量・定性のラインと「判断者」を明確にしておく必要があります。判断が曖昧だと、対応が遅れるか、逆に思いつきで対応してしまうリスクがあります。対応が必要だと判断した場合は、反論でも説明でも、科学的・客観的な根拠を、誰にでも分かる言葉で出すことが重要です。

広報担当者自身が普段から日本ファクトチェックセンター等のコンテンツを利用して情報を学び、目利き力を持つことも大切です。そして何より重要なのは、日頃から信頼を積み上げておくことです。信頼があれば、誤情報・偽情報が広がったときに、ファンが自然と反論して支えてくれます。企業の反論も、ファンが広げることで初めて説得力を持ちます。逆に、信頼が低い企業の反論はほとんど届きません。一番の備えは、日常的な信頼づくりなんだと思います。

誤情報時代の広報が押さえるべきポイント

誤情報・偽情報社会における企業の取り組み事例①

──フェイクニュースへの啓発活動として、企業が生活者に対して教育的なアプローチを行うことは重要だと思われますか。Yahoo!ニュースが開催した「FAKE NEWS MONSTERS展」は、古田さんがご監修された事例とお聞きしましたが、このような企業の発信をどう見ていますか。

本当にありがたい取り組みでした。Yahoo!ニュースさんのように「情報」に深く関わっている企業が、自分たちの責任としてフェイクの危うさを伝えようとするのは、とても意義があります。情報産業の中心にいる会社が関心を持って関わってくれることもうれしいですね。こういう活動は、もっと多くの企業に広がってほしいと思っています。

「Yahoo!ニュース」はフェイクニュースの危うさや、誤解しやすい情報の見え方を “モンスター” に見立て、

直感的に、楽しみながら学べる体験型イベントを2025年10月~11月に開催。

実は、NHKさんや新聞社などが、番組や記事でフェイク情報やアルゴリズムの問題をしっかり伝えているにもかかわらず、メディアリテラシーの知識って日本ではなかなか普及しないんです。例えば「バイアス」や「アルゴリズム」といった基本概念を理解している人は、1割いるかどうか。日本ファクトチェックセンターのコンテンツも、正直いって届いているのはごく一部です。それがすごくもどかしいなと思います。

だからこそ、広いリーチを持つクリエイターや企業が一緒に取り組んでくれることは本当に大切なんです。大きなプラットフォームとクリエイターが協働して、学べる企画を作っていく。そうした動きが増えることは、社会全体の“見抜く力”を育てるために、非常に心強いと思っています。

誤情報・偽情報社会における企業の取り組み事例②

──フェイクニュース啓発の取り組みとして、他に注目されている企業事例はありますか?また、生活者が興味を持つコンテンツとしては、有名クリエイターとの連携が中心になるのでしょうか。企業が日常的に発信できることがあれば教えてください。

実は、YouTubeやTikTokもクリエイターと組んでメディアリテラシーを伝えるコンテンツをつくっているんです。

例えばYouTubeの「#ほんとかな?が、あなたを守る」キャンペーンはご存じですか?これは継続的な取り組みで、僕がグーグルで働いていた2021年頃に初期の企画に関わりました。プラットフォーム側が責任をもって、生活者のメディアリテラシーを高めていく姿勢はとても重要だと思っています。

一方で、僕自身がずっと「本当はやりたい」と思いながら実現できていないものもあって。それは、日常のコンタクトポイントでリテラシーを伝える仕組みです。

例えば、スマホの機種変更の手続きの場。オンライン詐欺って今、右肩上がりで増えているじゃないですか。特に高齢者は、ターゲットにされてしまったら対処が難しい。でも、少しの知識さえあれば防げるケースが多いんです。じゃあ、どこでその知識を渡せるのかと考えると、“スマホを手にする瞬間”が一番確実なんですよね。店舗やキャリアが、機種変更のタイミングで「これは絶対にしないでください」というポイントをまとめた冊子や案内を必ず渡す。そういう仕組みがあれば、多くの被害は防げるはずなんです。生活者の興味を引くコンテンツも、クリエイターとの連携ももちろん大切ですが、同じくらい大事なのは、日常のどこでリテラシーをインストールできるかという視点だと思います。

広報担当者による生成AIとの“共創”について

──生成AIの活用が進む中で、広報担当者はどのようにAIと向き合っていくべきなのでしょうか? AIの注意点も含めてご教示ください。

AIはリスクを“減らしもすれば、増やしもする”存在です。うまく使えば、ファクトチェックに限らず、文化的・倫理的観点など、あらゆる「チェック」に活用できます。

とくに一人広報の方がよく抱える「相談相手がいない」という悩みに対しては、AIに相談すれば“別の視点を得る”ことができるという意味で、非常に有効な使い方だと言えます。AIにチェックを依頼したり、観点を追加してもらったりするのは、これからの広報にとって大きな助けになるはずです。

ただし同時に、AIだけではファクトチェックが完結しないという点には十分注意が必要です。どれだけ性能が向上しても、AIが完璧になることはありません。AIには大きく分けて2つの弱点──バイアスとハルシネーション(幻覚)──が存在します。

バイアスAIは世の中のデータを読み込んで学習しているため、現実社会に存在するバイアス(ジェンダー・人種など)をそのまま反映しやすく、ステレオタイプの再生産につながりかねません。これに気づくには、人間側が「世の中にはジェンダーや人種のバイアスがある」という基本的な知識を持っておく必要があります。ハルシネーション(幻覚)AIは「知らない」と答えるのが苦手で、都合のよい情報を自分でつくり出してしまう特性があります。誤った固有名詞や、存在しない事例をもっともらしく提示することも珍しくありません。そのため、AIが間違えやすい傾向──“知らないことを知っているように答えてしまう”──を理解しておくことが不可欠です。

──先ほど挙げていただいたAIの課題を踏まえた上で、広報担当者がAIを排除するのではなく、“共創”していくためには、どのような姿勢やプロセスが必要だとお考えでしょうか。

AIは非常に便利で効率的なツールではありますが、プロではないため精度は完璧ではありません。ただし、人間がゼロから全てを作業するよりはるかに効率的であり、下書きや案出しの段階では大きな力を発揮します。

そもそも下書きの段階で、誤情報・偽情報の生成を抑制するためには、良いプロンプトを使い、MyGPTなどの専用AIをしっかりと育てていくことが重要です。ついWeb検索のようにゼロからAIに聞いてしまいますが、それではAIを活用できているとは言えません。

「PARTS」を基にしたプロンプトを活用することをおすすめします。Persona(ペルソナ)、Aim(目的)、Recipients(対象)、Theme(テーマ)、Structure(構造)の5つの要素をそれぞれ明確にして、よりアウトプットの精度を上げましょう。

また、AIによって減った作業時間を、その分「確認の時間」にしっかり充てるという意識が求められます。

その際におすすめなのが、生成AIによる回答をチェックするための「AAAフレームワーク」です。これは、AIが生成したアウトプットに人間がどの観点で手を加えればよいかを整理したもので、次の3つで構成されています。

生成AIを活用する際は、こうした観点を押さえた上で、人間が「最後の確認者」として責任を持つことが、AIとの共創を成立させる上で欠かせません。

生成AIによる回答をチェックする際のAAAフレームワークAccurate:正確性✓誤りが含まれていないか。

✓出典は存在するか。提示してきたURLは捏造ではないか。

✓信頼できる根拠に基づいているか。

✓論理的な矛盾や推測、臆測に基づいた回答ではないか。Appropriate:適切性✓法的・論理的に適切か。

✓社会的な慣習から見て適切か。Aligned:整合性✓回答が求めていた方向性と一致しているか。

✓これまでの発信との整合性があるか。

生成AIでファクトチェックを行う際にも、企業のトンマナに合わせたドラフトを作成し、ドラフトを手直ししたものを、社会的倫理的に問題がないか・事実誤認がないかをAIでチェックすることが大切です。これを繰り返しつつ、最終的には人間がしっかりと確認するようにしましょう。

──実際にメディアがAIを活用する際は、最終的な人間による確認を重要視しているという調査結果もあると伺いました。

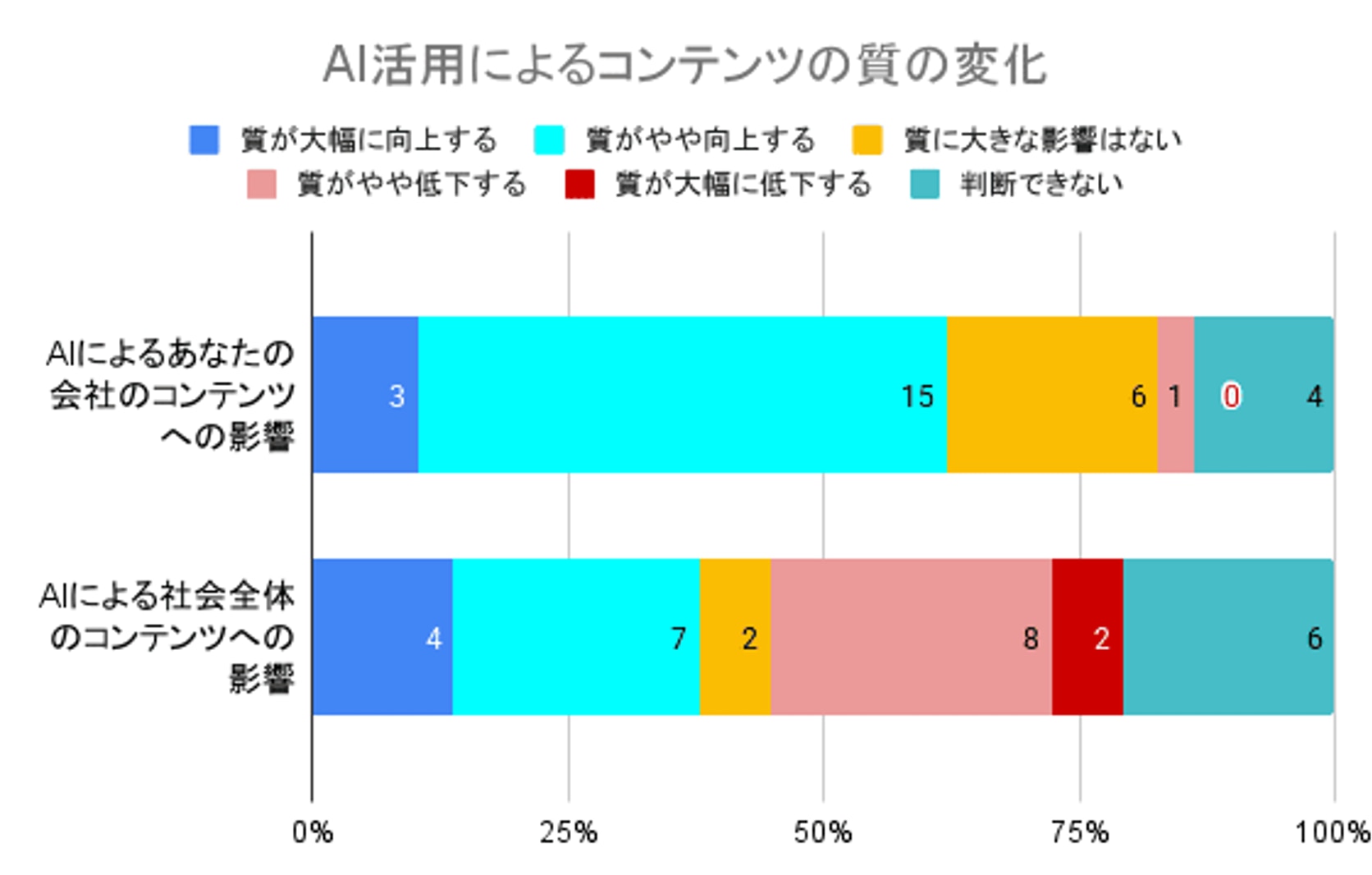

はい。日本新聞協会やインターネットメディア協会の加盟社29社を対象に行った調査結果があります。約7割(21社)の企業がAIを導入しており、導入社は社員数10~99人:約6割(4社)、100~499人:約6割(8社)、500~999人:10割(2社)、1000人〜:10割(7社)と、大手はほぼ導入済みで、中小メディアも導入が始まっているようです。

AI活用によるコンテンツへの影響について聞いたところ、約6割(18社)が自社のコンテンツの質が向上すると回答した一方、社会全体のコンテンツの質が向上すると答えたのは約4割(11社)で、質が低下するという回答が多く見られました。

これは約8割(22社)が生成・提案したコンテンツに関して常に人間の編集者が最終確認・修正をしているため、新聞社等はAIが生成したものを最終的に人間がチェックすることで質が向上することを実感しているものの、そのような使い方をしなければ質は低下すると考えていることが推察されます。

出典:一般社団法人デジタル・ジャーナリスト育成機構(D-JEDI)

「【編集局AI利用調査】AI導入が1年で急増する一方、 安全対策や高度な活用に課題 D-JEDIで11月にセミナーを開催! 」

まとめ 生成AIが言葉を大量に生み出す時代に、企業が“信頼される言葉”を発信するために

──広報担当者としては、AIが生成したアウトプットの最終確認を踏まえ、どのような点に手を加えるべきなのでしょうか?

繰り返しになりますが、生成AIは本当に素晴らしい技術だと思います。でも同時に、AIがやっていることは、世の中にある大量のデータを組み合わせて“もっともらしい言葉”をつくり出しているに過ぎないとも言えるんですよね。だからこそ、最終的な言葉の質や方向性を決めるのは、やっぱり人間の広報担当者の仕事なんです。

企業のサービスや姿勢を一番深く理解しているのはAIではなく、そこに日々向き合っている広報担当者です。「この言葉は自社らしいか」「この説明に私たちの価値観は表れているか」といった判断は、AIにはできません。そこに人間の“責任”や“体温”が宿るわけです。

だから、AIとの向き合い方として大事なのは全てをAIで置き換えることではなく、AIを“下ごしらえ”に使って、人間が最後の味を調えることだと思っています。AIに任せられる部分はどんどん委ねていい。でも、企業の思いが伝わる一言や、微妙なニュアンス、生活者の気持ちを想像した言い回し等、そういった部分にこそ、広報担当者が手を加える意味があります。

言い換えれば、AIによって広報の仕事が奪われるのではなく、広報が“本当にやるべき仕事”に集中できる時代になったとも言えるんです。

企業の価値をどう言葉に変換するか。その本質的な部分こそ、人にしかできないことで、その点において広報の役割はこれからもっと大きくなると思います。

※引用されたデータや状況、人物の所属・役職等は本記事執筆当時のものです。

▼電通PRコンサルティング「デジタルPR」サービス紹介資料をダウンロード

▼電通PRコンサルティング「危機管理広報プログラム」サービス資料をダウンロード

▼関連記事

・AI検索に"選ばれる"情報とは?広報担当が知っておくべきAEO戦略の基本と実践

・PR視点×メディア視点で実現する「動かす」情報設計とは? AIではつくれない“気づき”と“文脈”が生むオウンド戦略の本質的価値を解説